ARTICLES

Actually developing applications:

Stage 1 completed – Scene Production Service BETA

https://www.youtube.com/watch?v=fmKGQ7dcZdk

https://github.com/c100rczyk/Thesis_project_PWR

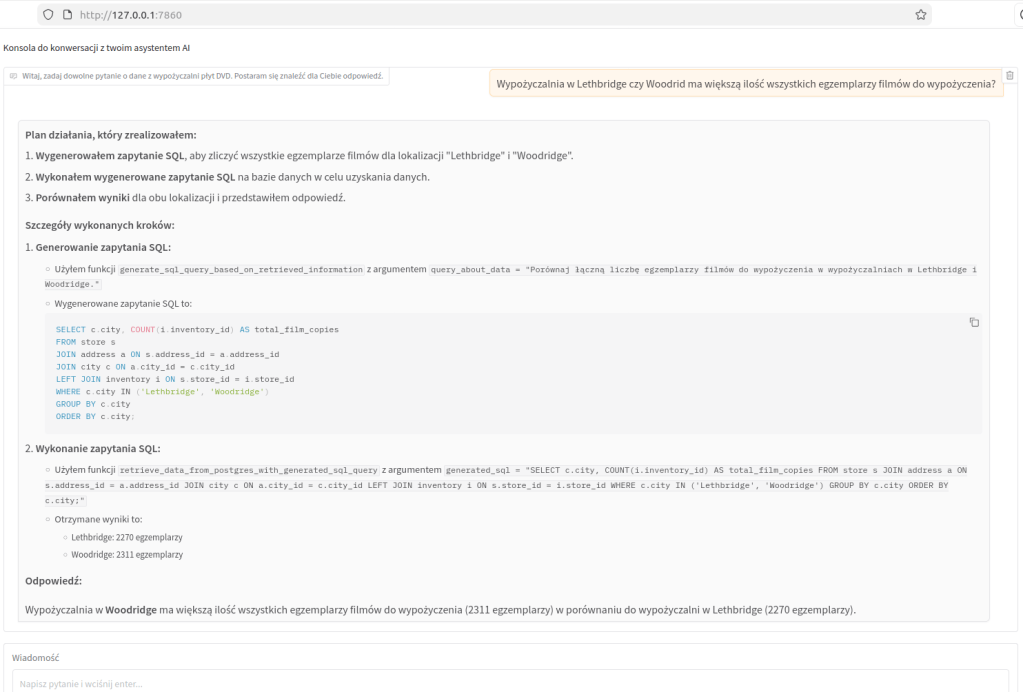

Application helper chat Prototype

Providing the user with relevant information about the data from the application he is using.

(The github repository of this project is not accessible for public)

Trending

Orders for individual customers:

In the future

Recomendation of courses:

Machine Learning: Machine Learning Specialization (Coursera)